簡単・非侵襲的・安価な認知症スクリーニング法が望まれる

東京大学医学部附属病院は1月26日、認知機能が低下した患者と健常者の顔写真を見分けることができる人工知能(AI)モデルを開発したと発表した。これは、同病院老年病科の秋下雅弘教授、亀山祐美助教(特任講師(病院))らと、東京都健康長寿医療センター放射線診断科の亀山征史医長との共同研究によるもの。研究成果は、「Aging」に掲載されている。

画像はリリースより

認知症診断のための検査はさまざまな制約を抱えている。アミロイドPETによる検査費用は非常に高額で、脳脊髄液の採取は侵襲的であることから、簡単で非侵襲的で安価な認知症のスクリーニングが望まれている。

また、老化は全身的なプロセスのため、顔で判断する見た目年齢は余命、動脈硬化、骨粗しょう症の指標となることが知られている。これまでに秋下教授らのグループは、見た目年齢が暦年齢よりも認知機能と強い相関を示すことを報告している。そこで今回、人工知能(AI)を使って、顔の情報から認知機能低下を見つけ出すことができるかどうかを調べた。

最良AIモデルの成績は感度87.31%、特異度94.57%、正答率92.56%

東京大学医学部附属病院老年病科を受診して物忘れを訴える患者、および同大学高齢社会総合研究機構が実施している大規模高齢者コホート調査(柏スタディ)の参加者の中から同意を得た人の、正面の表情のない顔写真を使い、認知機能低下を示す群(121人)と正常群(117人)の弁別ができるかどうかについて、AIワークステーションで解析した。

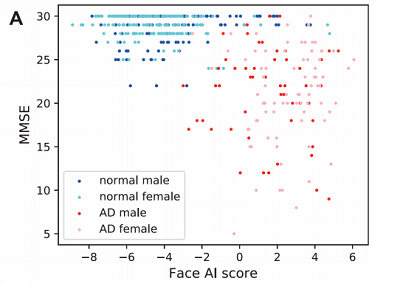

何種類か試した中で最も良い成績を示した AIモデルは、感度87.31%、特異度94.57%、正答率92.56%と高い弁別能を示した。AIモデルが算出するスコアは、年齢よりも認知機能のスコアに有意に強い相関を示した。さらに、年齢の影響を少なくするため、年齢で2つのグループに分けて解析したところ、どちらの群でも良好な成績を収めることができた。このことから、年齢の影響は少ないと考えられるという。

顔の上半分より下半分の方が少し好成績

AIワークステーションによる判断は顔のどの部分で行われているのかがわかりづらく、ブラックボックスの側面がある。そこで、顔を上下で分けて解析したところ、どちらも良い成績であったが、顔の下半分のほうが少し良い成績を示した。

今回の研究は人数が限られているため、そのまますぐに応用できるわけではないが、もっと多くの顔写真を集め、AIに学習させることができれば、将来的にAIを用いて顔で認知機能低下をスクリーニングすることができるようになるかもしれないという。「実用化を目指し、今回の成果から得られた方法について研究を深めていく」と、研究グループは述べている。

▼関連リンク

・東京大学医学部附属病院 プレスリリース